場景圖( scenegraphs , SGs )在計算機視覺和計算機圖形學中都是一種可解釋的、結構化的場景表示。場景圖總結了場景中的實體以及它們之間的合理關系。 SGs 在計算機視覺、機器人、自主車輛等領域有著廣泛的應用。

當前的 SG 生成技術依賴于昂貴的標記數據集的有限可用性。合成數據是解決這個問題的一個可行的選擇,因為注釋基本上是免費的。盡管合成數據已被用于圖像分類、目標檢測和語義分割等多種任務,但合成數據用于 SG 生成和視覺關系仍有待探索。由于合成數據和真實數據在外觀和內容上的差異,在有標記的合成數據上訓練神經網絡模型,在無標記的真實數據上進行評價,這就導致了領域差距問題。

Sim2SG 框架

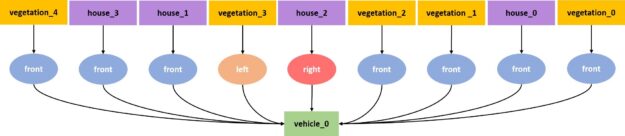

為了克服這些挑戰,我們提出了 Sim2SG ,一種可擴展的 sim-To-real 場景圖生成技術。本研究的主要目的是通過在含有標記 SG 信息的模擬數據集上訓練神經網絡,然后將學習到的模型轉換到真實數據集上,從真實世界的圖像中生成場景圖。

在訓練過程中, Sim2SG 處理域間隙并學習生成場景圖。域間隙可細分為以下間隙:

- 外觀間隙 是兩個域的外觀差異,例如場景中對象的紋理、顏色、光照或反射率的差異。

- 內容差距 是指兩個域之間的差異,包括對象數量分布的差異及其類別、位置、姿勢和比例。

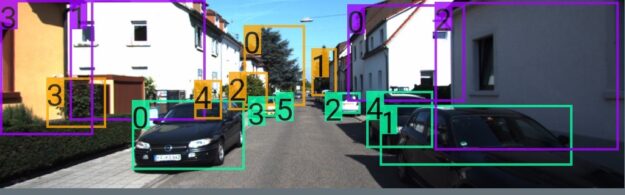

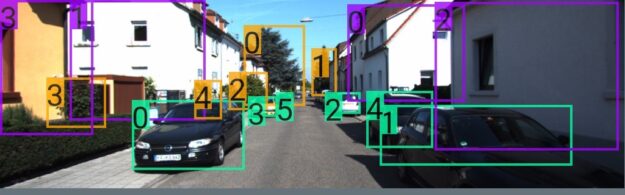

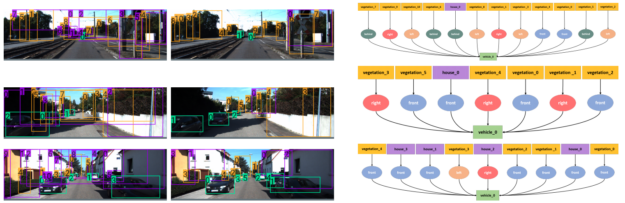

我們進一步分析了內容差距,并解決了其子組成部分 – 標簽和預測差異。圖 1 顯示了 Sim2SG 為真實世界的駕駛數據集生成精確的場景圖,圖 2 顯示了整個管道。

在圖 2 中, Sim2SG 管道將來自源域的帶標記的合成數據和來自目標域的未標記的真實數據作為輸入。使用編碼器將標記的合成數據和未標記的真實數據映射到共享表示 Z 。然后,我們使用合成數據在 Z 上訓練場景圖預測網絡 h 。我們使用基于偽統計的自學習方法來處理標簽差異,生成標簽對齊的合成數據以供訓練。我們進一步利用梯度反轉層( GRL )和域鑒別器的對抗性技術來調整兩個域之間的預測差異和外觀差異。

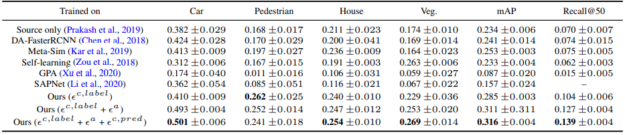

定量評價

我們使用了四種類型:汽車、行人、植被和房屋,以及四種類型的關系:前、左、右和后。所有的關系都以汽車為主題。

表 1 顯示了與基線相比,標簽對齊和外觀對齊在所提出的方法中如何顯著地減少域間隙。我們將 Sim2SG 與基于隨機化的方法( Prakash et al ., 2019 )、解決內容差距的方法( Kar et al ., 2019 )、基于偽標簽的自學習方法( Zou et al ., 2018 )和用于目標檢測的域自適應方法( Chen et al ., 2018 ; Xu et al ., 2020 ; Li et al ., 2020 )進行了比較。通過結合標簽、外觀和預測對齊(最后一行),域間隙進一步減小。

定性評價

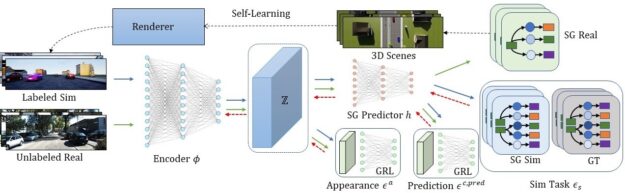

圖 3 顯示了 Sim2SG 在目標域上的定性結果。第一列顯示僅源基線無法檢測到對象或具有大量誤報(錯誤標記),從而導致場景圖不佳。我們的方法能夠更好地檢測對象,具有更少的誤報,并最終生成更精確的場景圖,分別如第二列和第三列所示。這是因為外觀對齊項減少了假陽性檢測。此外,標簽對齊項還提高了檢測性能,因為它有助于生成用于訓練的合成數據,這些數據與目標域的標簽對齊程度更高。圖 4 顯示了一些與目標域樣本相對應的標簽對齊的合成重建。

概括

在這項工作中,我們提出了 Sim2SG ,一個模型,實現了 sim-to-real 轉移學習場景圖生成上未標記的真實世界數據集。我們將域間隙分解為合成域和真實域之間的標記、預測和外觀差異。我們提出了解決這些差異的方法,并在所有三種環境( Clevr 、 dinning-Sim 和 Drive-Sim )中實現了基線的顯著改進。

有關更多信息,請參閱以下參考資料: