Posts by Min-Hung Chen

數據中心/云端

2025年 6月 9日

借助 EoRA 快速恢復 LLM 壓縮錯誤的免微調方法

模型壓縮技術已經過廣泛探索,可減少為大語言模型 (LLM) 或其他大型神經網絡提供服務所需的計算資源。 但是,與未壓縮的模型相比,

5 MIN READ

計算機視覺/視頻分析

2024年 6月 28日

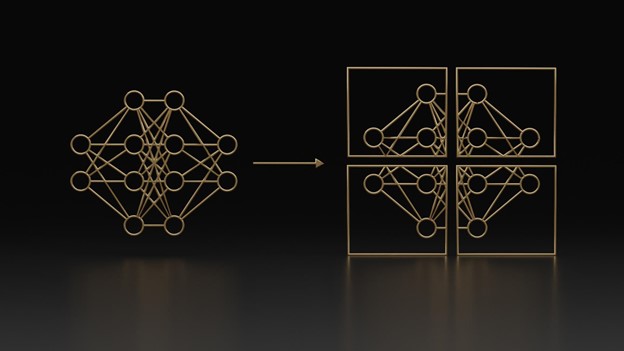

推出高性能微調解決方案 DoRA,LoRA 的替代選擇

全微調(FT)通常用于針對特定的下游任務定制通用預訓練模型。為了降低訓練成本,我們引入了參數高效微調(PEFT)方法,

3 MIN READ